YouTubeにAI規制導入!動画削除や収益化停止の可能性も

ついに YouTube で、いわゆる AI 規制に関するポリシーが導入されました。公式のヘルプページなどでも、以前より詳細な情報が公開されたのですが、正直対象となるコンテンツの範囲が広いなと感じました。

例えばゆっくり実況やずんだもんなどの機械音声・合成音声はどうなるのかや、どのような AI 生成コンテンツを使用した場合に対象となるのか疑問に感じる部分も多いと思います。

※このページの内容は動画でもご紹介しております。

目次

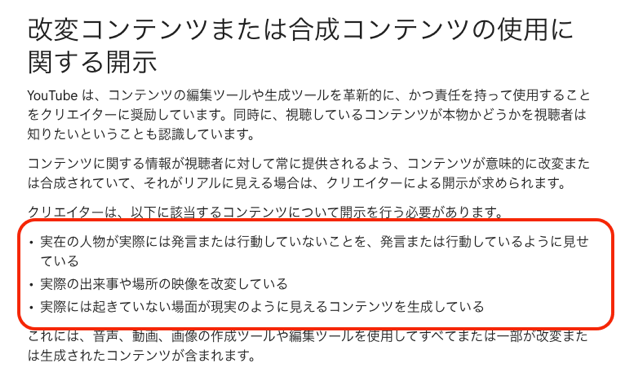

AI 生成コンテンツに限らない

まず今回導入されたポリシーの対象は AI 生成コンテンツに限りません。AI ばかりが注目されてしまっていますが、AI 生成コンテンツを含め「改変コンテンツ」または「合成コンテンツ」が対象となっています。改変コンテンツや合成コンテンツと言われても分かりにくいですよね。

これは AI のような機械が生成したものを含め、加工された画像・動画・音声、合成された画像・動画・音声です。例えば、実際に撮影された写真や動画に幽霊を合成したり、実際には映っていたものを除去してしまうなどです。

ヘルプページには「実在の人物が実際には発言または行動していないことを、発言または行動しているように見せている」「実際には起きていない場面が現実のように見えるコンテンツを生成している」と記載されています。

例えば、ある有名人が実際には話していないことを実際に話しているかのように表現したり、災害が起きていない場所なのに災害が起きているような映像にするなどです。正直、AI を使えば簡単にできてしまいます。

このようなコンテンツは、実際の出来事なのかを判断するのが非常に難しくなってきているため、視聴者が間違った情報を鵜呑みにしてしまったり、騙されてしまうこともあります。

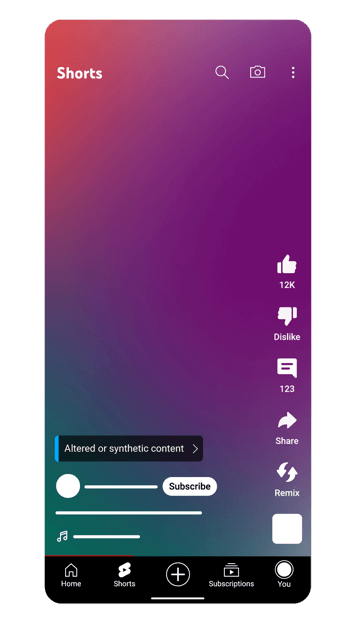

そこで今回導入されたポリシーです。改変コンテンツや合成コンテンツが含まれる場合、それを視聴者に開示しなければならなくなりました。

勘違いされる方が多いのですが、AI 生成コンテンツや改変コンテンツが禁止されたわけではありませんし、収益化できないわけでもありません。動画のインプレッションなどで不利になることもありません。開示することが必要になったということだけです。

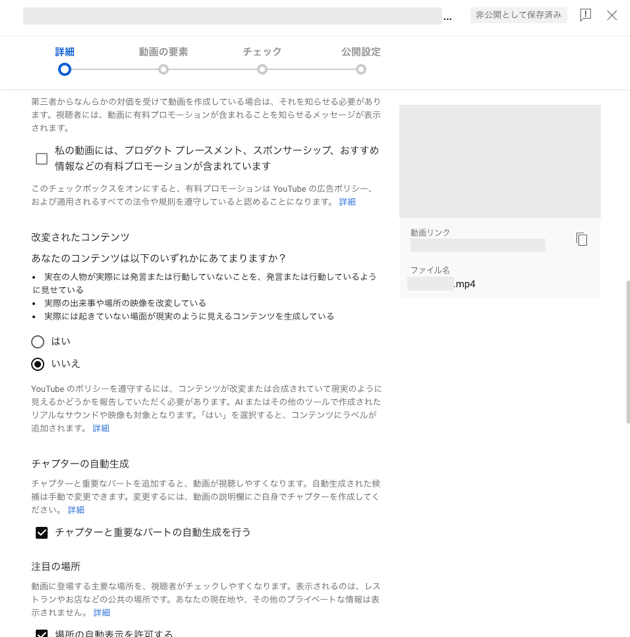

YouTube Studio で[改変されたコンテンツ]の設定

既に YouTube Studio では動画公開時の詳細画面に[改変されたコンテンツ]の項目が追加されています。

「あなたのコンテンツは以下のいずれかにあてはまりますか?」とあり、「実際の人物が実際には発言または行動していないことを、発言または行動しているように見せている」「実際の出来事や場所の映像を改変している」「実際には起きていない場面が現実のように見えるコンテンツを生成している」と記載されています。

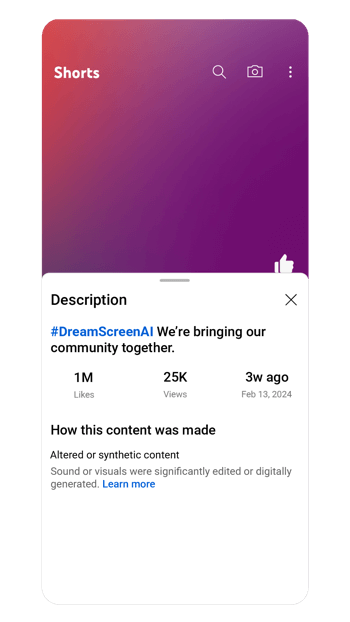

「はい」を選択した場合、説明欄等にこのようなラベルが表示されます。

もし、医療 / 健康、ニュース、選挙、金融などデリケートなトピックを扱う動画の場合は動画プレーヤーにも、より目立つラベルが表示されるようです。

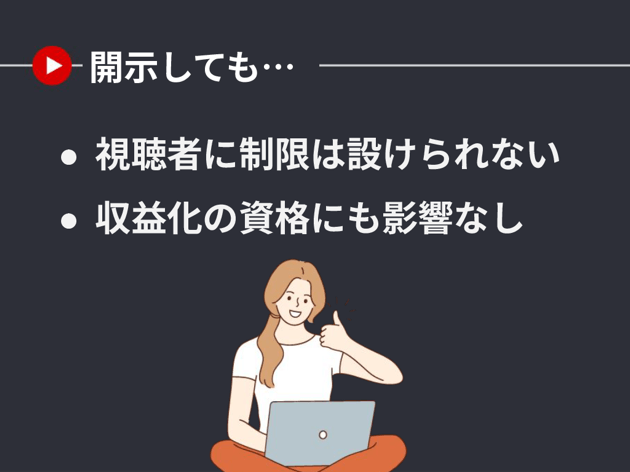

ちなみに、開示を行ったとしても動画の視聴者に制限が設けられることはなく、収益化の資格にも影響はありません。つまり、開示したからと言って動画のインプレッションに制限がかかり再生回数が減るようなことや、収益化が無効になることもありません。

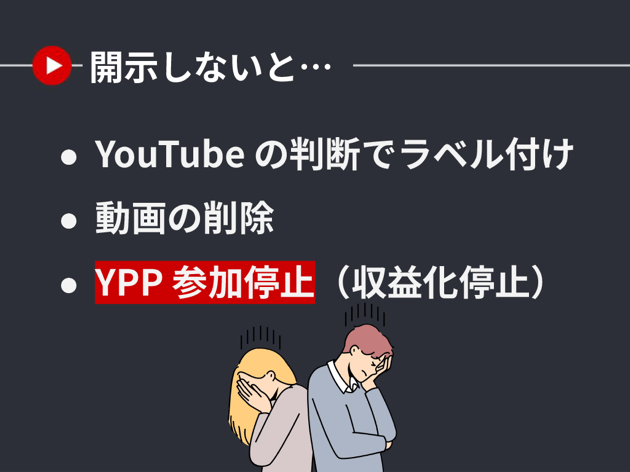

むしろ、本来開示が必要なコンテンツにも関わらず開示しなかった場合は、クリエイターが設定でオフにできないラベルを YouTube が付けることがあります。また動画の削除や YouTube パートナー プログラムへの参加停止(収益化停止)など、YouTube によるペナルティが科される可能性があるため、開示しないリスクは大きいです。

改変コンテンツの例で考える開示対象

ただし、改変されたコンテンツであっても、すべてが開示対象となるわけではありません。ヘルプページにも「リアルなコンテンツや意味的な変更が行われたコンテンツについては開示が必要ですが、非現実的なコンテンツや軽微な編集については開示は不要です。」と記載されています。

クリエイターによる開示が不要な例

- 美顔フィルタを適用する

- 車が動いているように見せるため、背景を合成または拡張する

- エフェクトを使用して、過去に録音された音声を補正する

- 動画で AI が生成したミサイルのアニメーションを使用する

- ユニコーンに乗って幻想的な世界を旅する人物

- 色調整や照明に関するフィルタ

などがあります。視聴者が勘違いしたり、認識を誤るようなものでない軽微な編集であれば開示しなくても良いということですね。

アニメーションのようなリアルではないもの。もしリアルなものであっても、ユニコーンに乗っているとか宇宙に浮かぶ様子を描いたとしても、明らかに実際に起きたことではないと分かる非現実的な内容も開示が不要です。

開示が必要な例

- 人物の顔を別人の顔に置き換える

- 有名なカーチェイスのシーンをデジタル的に改変し、元の映画には存在しなかった有名人を登場させる

- 医療専門家が実際には助言していないのに、助言したように聞こえるよう音声をシミュレーションする

- 実在する都市に向けてミサイルが発射される様子をリアルに描写する

- ナレーションでの使用を目的として他人の声の音声クローニングを行う

- 実際には言われていないアドバイスが言われたかのように見せる

などがあります。視聴者が本物だと思い、勘違いしてしまう可能性があるものに関しては開示が必要です。

自分の動画は開示が必要なのか

AI 生成コンテンツや改変コンテンツを全く使用していないクリエイターの方であれば影響がないわけですが、中には「自分のコンテンツが開示が必要か明確に判断できない」という方もいると思います。

例えば、機械音声・合成音声を使用しているクリエイターだと「ゆっくり系は開示が必要なの?」「ずんだもんだったら?」と悩むかもしれません。

ここから話すことは私の個人的な解釈なので、参考程度にしていただければと思います。

ゆっくり解説やゆっくり実況で知られる「ゆっくり」の音声であれば、開示はしなくても大丈夫だと思います。ゆっくりの音声は明らかにリアルな人の声とは言えませんし、実在する人の声だと勘違いする方も少ないでしょう。

一方で実在する人の声を元に生成した音声を使用する場合は開示が必要だと考えられます。例えば、TikTok ではヒカキンさんの声でテキストを読み上げさせる機能がありますが、本当にヒカキンさんが話していると勘違いする人もいるでしょう。

他にも AI 音声で有名な CoeFont のような、有名なナレーターやアナウンサー、声優、著名人の声で音声を生成できるものも開示が必要だと思います。

では、著名人の声ではない合成音声やずんだもんのようなキャラクターの合成音声はどうでしょうか。実際に人が話しているように聞こえる合成音声は多く、リアルさという点においては開示が必要だと考えられます。しかし、実在する人物ではなく視聴者が勘違いするようなことがないのであれば開示しなくて問題なさそうだとも考えられます。

このあたりはグレーゾーンになり得る部分で、正直使い方にもよると思います。例えば誰かの写真を表示し、その人ではない合成音声を入れるような場合だと、その写真の人の声だと勘違いしてしまうため開示が必要ではないでしょうか。

グレーゾーンに該当する部分は、今後クリエイターや視聴者の状況によって段々と明確になっていく可能性があると思っています。もしかしたら、ゆっくりを含めて合成音声のすべてが開示必須となることもあり得るかもしれません。またアップデートがあり次第、このサイトでもご紹介いたします。

なお、収益化を目指す方は下記もぜひご覧ください。

![生活に役立つネタを!iscle[イズクル]](https://www.iscle.com/image/toplogo.svg)